TAIS 2024 について

Technical AI Safety 2024は、レクチャーシリーズとして構成された小規模な非アーカイブのオープン学術会議である。2024年4月5日から6日までの2日間、東京・お台場のプラザ平成国際会議場で開催された。

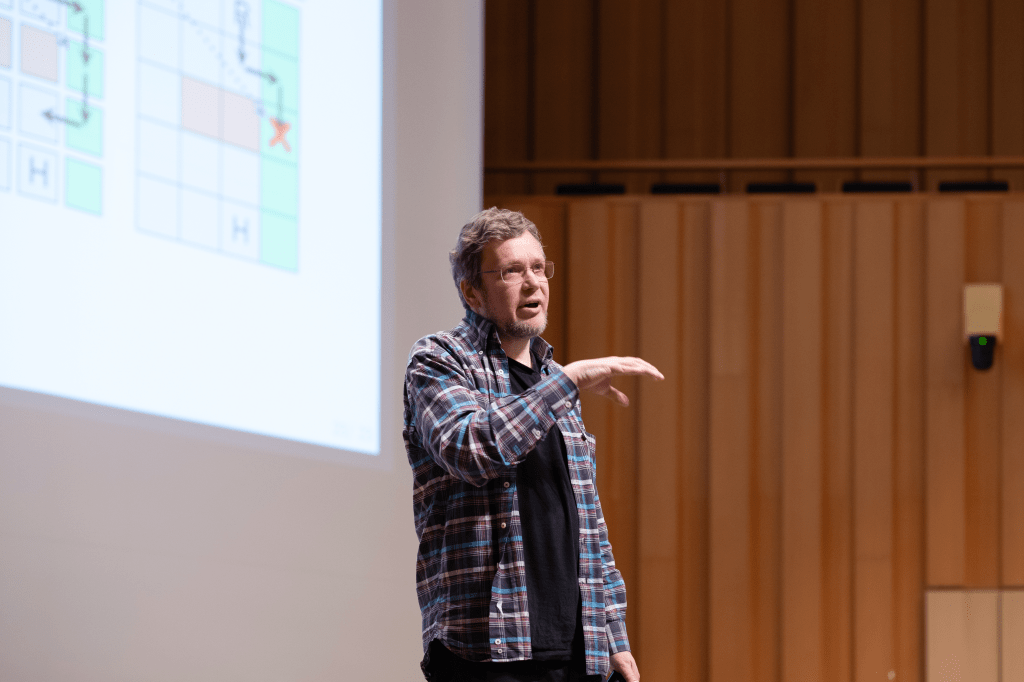

技術的なAIの安全性に関する6つの研究課題について、18の講演が行われた:

- 機械論的解釈可能性

- 発展的解釈可能性

- スケーラブルな監視

- エージェント基盤

- 因果的インセンティブ

- ALIFE

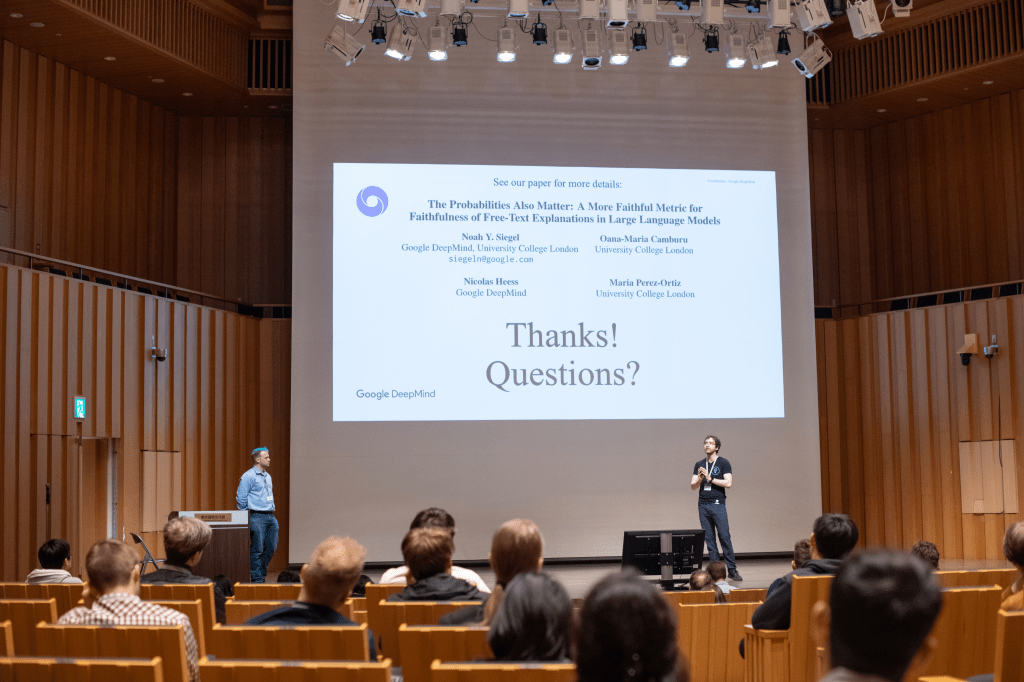

HoagyCunningham(Anthropic)、Noah Y. Siegel(DeepMind)、Manuel Baltieri(Araya)、Dan Hendrycks(CAIS)、Scott Emmons(CHAI)、Ryan Kidd(MATS)、James Fox(LISA)、Jesse HooglandとStan van Wingerden(Timaeus)の講演を含む。詳細はアジェンダをご覧ください。

ポスターセッションも開催されました。最優秀ポスター賞は、Fazl Berez氏の「Large Language Models Relearn Removed Concepts」とAlex Spies氏の「Structured Representations in Maze-Solving Transformers」が受賞しました。

当日の参加者は105名(講演者を含む)。ライブストリーミングの視聴者数は約400人で、最大同時視聴者数は18人でした。

カンファレンスの録画はユーチューブ・チャンネルでご覧いただけます。

主催者について

TAIS2024は、AI Safety東京とNoeon Researchが主催し、AI Alignment Network、AI産業基盤、Reaktor Japanのスポンサーによりご提供いたします。

ご質問がある場合はblaine@aisafety.tokyoまでご連絡ください。

AI Safety東京は、日本におけるAIセーフティコミュニティの構築と支援を行っています。このグループは、技術的なアライメント研究や、AIガバナンスのための優れた政策の開発など、AIの安全性について考え、活動することに関心のある専門家や学生を支援しています。中心的な活動は、セミナーシリーズ/読書会/勉強会であり、参加者がAI安全に関する文献の脈拍を常に把握できるようにしています。

Noeon Researchは、事実、知識、アルゴリズムを共有空間で表現できる新しいグラフベースの知識表現に基づき、一般的な知能と問題解決のための新しいアーキテクチャを構築する研究会社である。同社のアーキテクチャは、大規模な言語モデルのような競合アーキテクチャよりも安全である。その理由は、構造上解釈可能であることと、実世界の膨大なデータセットで訓練された他のアーキテクチャとは異なり、能力が高くなればなるほど必ずしも実世界的になるとは限らないからである。ノイオンリサーチは、TAIS 2024を後援することで、東京に同じ志を持つ専門家のコミュニティを構築し、会話を前進させ、研究成果を増加させたいと考えています。ノエオンリサーチの安全に対するスタンスについては、こちらをご覧ください。

“Let’s enjoy a long AI summer,

not rush unprepared into a fall.”

Web and branding by Chelsey Winkel – 2025